BAGAIMANA NEURAL NETWORKS BELAJAR?

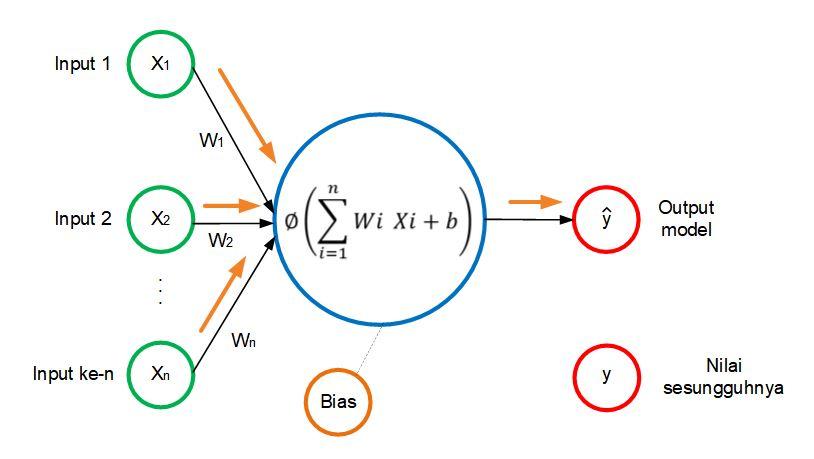

Untuk bisa memahami bagaimana neurons (perceptrons) belajar dan akhirnya mendapatkan hasil yang diinginkan, kita akan memulainya melalui beberapa tahapan. Mari kita lihat ilustrasi berikut:

Kita memiliki 3 layers, yaitu input layer, sebuah hidden layer, kemudian sebuah output layer. Di bagian output layer, akan menghasilkan sebuah nilai y topi. perlu diperhatikan bahwa y model (dengan tanda sebuah topi di atasnya) adalah nilai hasil dari model neural networks kita, sementara nilai yang sesungguhnya adalah y (tanpa topi).

Sekarang, mari kita bahas tahap demi tahap prosesnya.

TAHAP 1: MENDAPATKAN NILAI Y MODEL

Sesuai pembahasan sebelumnya, melalui hidden layer dan output layer didapatkan nilai y topi.

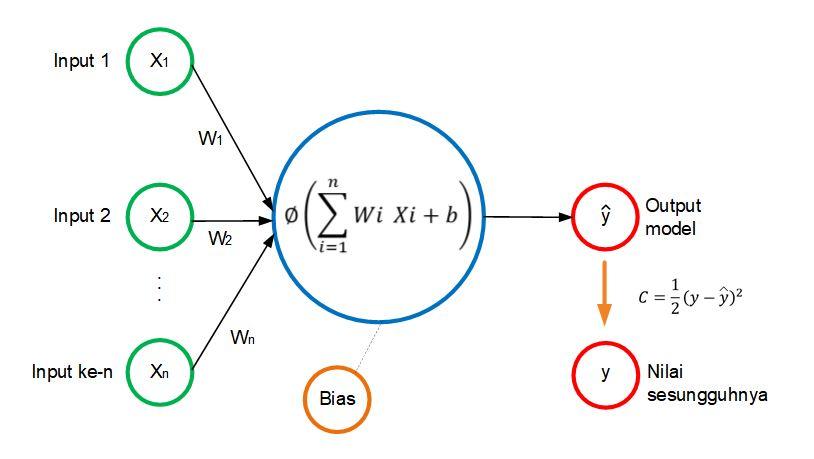

TAHAP 2: MEMBANDINGKAN Y MODEL DENGAN Y REAL

Sekarang kita bandingkan nilai y yang didapat dari model, dengan y sesungguhnya (dari dataset). Untuk bisa membandingkan kita gunakan formula cost function (simbol C di gambar). Dari formulanya kita bisa melihat bahwa semakin identik nilai antara y model dengan y real, maka nilai C akan semakin kecil. Jika sama persis maka nilai C=0 (sangat jarang terjadi).

Ilustrasi perbandingan antara y model dan y real tampak sebagai berikut:

Tujuan kita adalah meminimalisi nilai C-nya. Dengan demikian, semakin baik model NN kita maka nilai C pada histogram di atas akan semakin kecil.

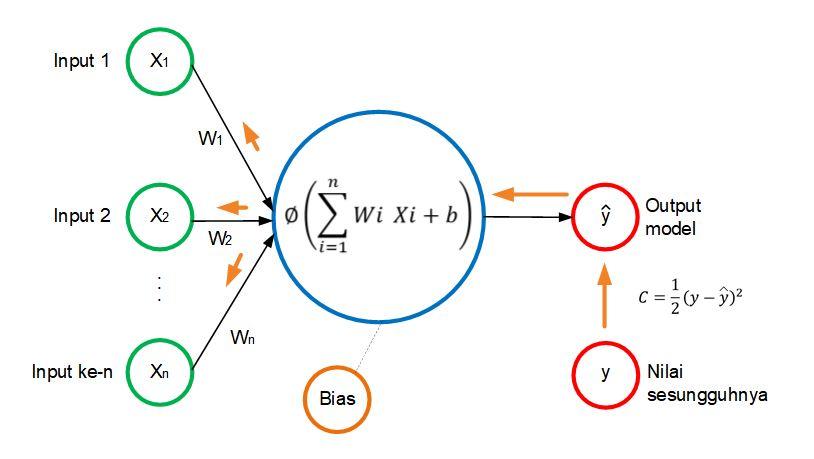

TAHAP 3: MEMBERIKAN FEEDBACK KE BELAKANG DAN UPDATE NILAI W

Sekarang kita mengupdate nilai w1, w2 sampai wn. Proses update ini kita sebut dengan istilah back propagation. Tujuan update ini adalah agar ketika nanti kita tembakkan lagi sinyal menuju ke output layer, diharapkan nilai y model semakin mendekati y real.

Pertanyaan yang mungkin muncul adalah nilai bobot mana saja yang harus diupdate? Nanti akan dijelaskan di pembahasan back propagation. Saat ini kita fokus ke alur umumnya dulu agar tidak terlalu banyak informasi yang harus diterima pembaca.

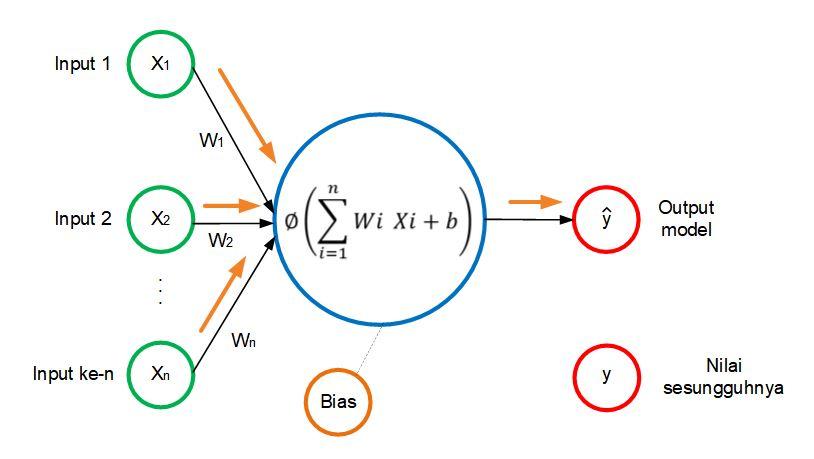

TAHAP 4: MENGHITUNG LAGI NILAI Y MODEL SETELAH W DIUPDATE

Setelah kita hitung lagi sekarang perbandingan nilai y adalah sebagai berikut:

Bisa kita lihat sekarang y model dan y real sudah sangat mendekati, dan ditunjukkan dengan nilai C yang semakin kecil.

TAHAP 5: UPDATE TERUS NILAI W SAMPAI NILAI C MENJADI MINIMUM

Sekarang kita mundur ke belakang lagi (back propagation) untuk mengupdate nilai w. Setelah itu hitung lagi nilai y model. Mundur lagi update nilai w, maju lagi menghitung nilai y model dan seterusnya sampai nilai C betul-betul paling kecil.

Proses ini akan terus berlangsung sampai nilai C menjadi converge. Apa itu converge? Artinya adalah nilai C sudah tidak bisa turun lagi. Mungkin saja turun tapi sangatlah kecil perubahannya, dan tidak signifikan. Jika sudah seperti ini, maka kita sudah berada di solusi yang optimum.

Yang harus diingat saat proses mencari kondisi optimum, nilai C tidak selamanya turun. Bisa jadi ia naik, kemudian turun lagi. Kenapa demikian? Kita ibaratkan kita berada di sebuah pulau, dan tujuan kita adalah mencari kolam yang paling dalam di pulau ini (ada banyak kolam). Maka saat perjalanan kita menuju kolam, pasti datarannya tidak selamanya rata, ada yang naik dan kadang turun, sampai kita benar-benar bisa menemukan kolam yang paling dalam. Semoga ilustrasi ini bisa memberikan gambaran proses pencarian titik optimum.Ilustrasi ini adalah gambaran dari proses gradient descent yang nanti akan dibahas lebih detail.

Sekarang, anggap sekarang kita sudah memiliki solusi yang converge, maka perbandingan y nya tampak sebagai berikut:

Jadi begitulah proses bagaimana neural networks bisa memecahkan sebuah permasalahan.

Perlu diperhatikan, bahwa semua ilustrasi di atas adalah untuk melatih NN berdasarkan 1 baris data saja. Misal kita ingin memprediksi nilai mobil bekas, maka ilustrasi di atas hanya membicarakan 1 mobil bekas saja. Anggap saja mobil bekas dengan nomor ID 1.

Lalu bagaimana jika ada banyak mobil bekas? Bagaimana proses neural networks-nya? Bisakah neural networks meramal sekian banyak tipe mobil bekas? Jawabannya masih mirip dengan pembahasan di sini, namun ruang lingkupnya saja yang lebih besar.

Untuk melanjutkan membaca silakan klik lanjut ke halaman berikutnya di bawah ini.

Halo pak, artikel di atas bapak menyebutkan ”Jika semua baris (ada 8 baris) sudah dihitung nilai y modelnya, dan setiap kembali mengupdate nilai w untuk masing-masing barisnya maka disebut dengan 1 epoch”, pertanyaan saya 8 Baris itu berasal dari mana yah Pak?, bukan nya ada 10 baris data yah, apa saya yang salah tangkap..terima kasih pak

Maaf Pak, saya lihat pernyataan tsb ada di halaman 5 di topik pembahasan “Deep Learning: Artificial Neural Networks ” yang di highlight biru..Terima kasih

Yang betul 10 baris, sepertinya salah ketik.

halo pak izin mengoreksi “Jika menggunakan batch gradient descent, maka kita bisa terjebak di solusi global (global optimum).” pada halaman 6, seharusnya solusi lokal ya pak. Barangkali membantu, terima kasih

Iya salah ketik, terima kasih koreksinya.

maaf kak, kalau data kita 4 baris, berapa nilai batchsizenya?

4 baris tidak perlu deep learning

Halo pak, dari yang saya pahami untuk Neural Network ini konsepnya apa memang sama dengan Backpropagation Neural Network?.

Saat ini saya sedang mengerjakan skripsi dengan topik prediksi curah hujan menggunakan Bpnn dioptimasi dengan PSO (Particle Swarm Optimaztion).

Data yang saya gunakan data curah hujan bulanan dengan memiliki kurang lebih 70 stasiun pengukur. Data time seris dari tahun 2013 – 2023. Apakah dalam pengerjaan saya harus membuat model sebanyak stasiun pengukur yang ada? atay 1 model untuk semua stasiun?

Iya neural network memang menggunakan backpropagation.

Mungkin yang dimaksud jumlah neuronnya? Bebas saja untuk jumlah neuron, tinggal nanti pilih settingan model terbaik.